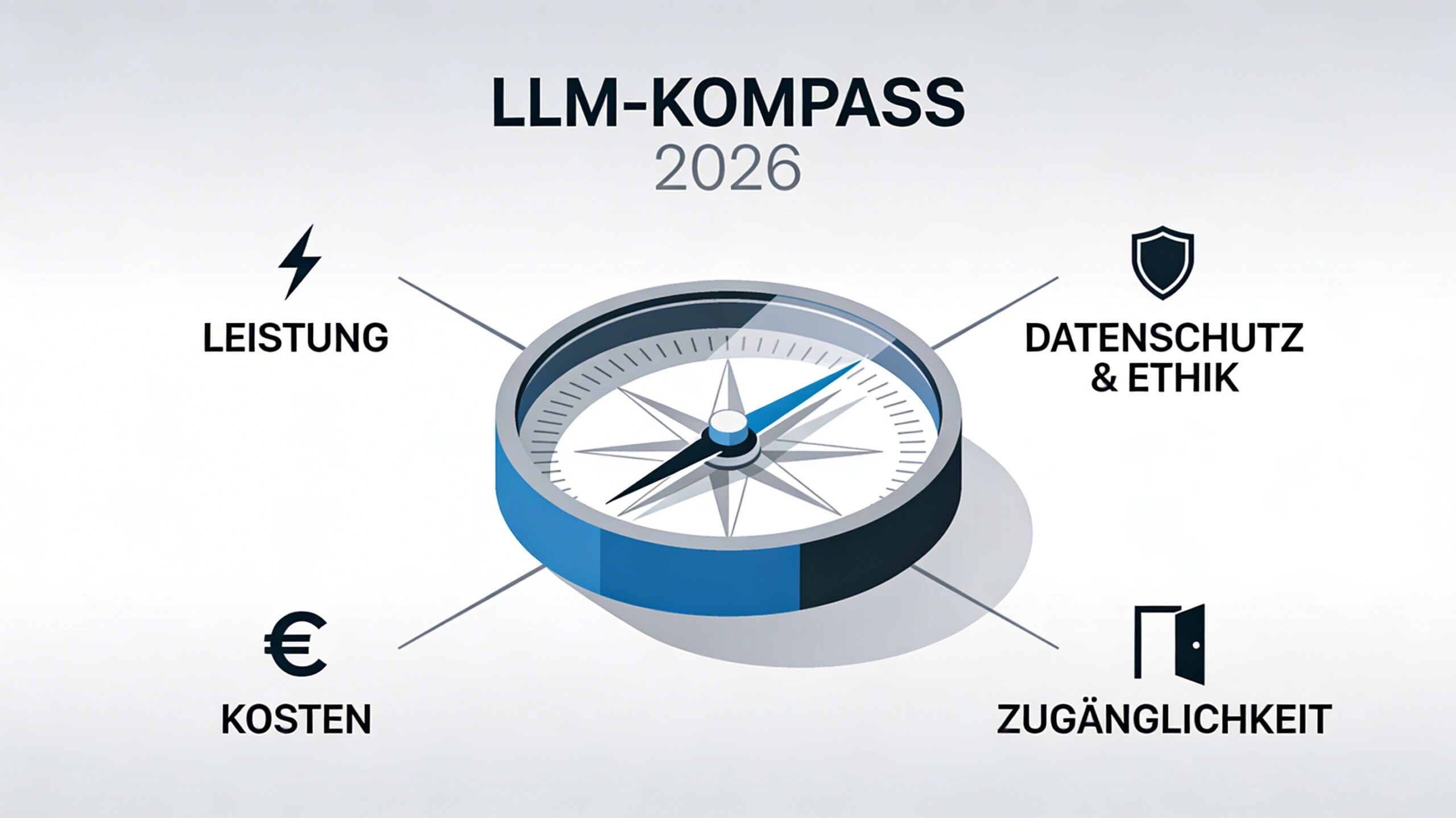

ChatGPT kennen Sie. Aber kennen Sie auch Claude, Perplexity oder DeepSeek? Die LLM-Landschaft 2026 ist vielfältig – und genau das ist Ihre Chance. Dieser Kompass hilft Ihnen, das passende Werkzeug für Ihre Bedürfnisse zu finden

Transparenz

Text und Bild(er) mit KI-Unterstützung erarbeitet.

Warum diese Übersicht jetzt?

Seit Ende 2022 hat sich die Welt der großen Sprachmodelle dramatisch verändert. Was mit ChatGPT begann, entwickelte sich zu einer explosionsartigen Vielfalt: Über zwanzig verschiedene Modelle und Dutzende Plattformen konkurrieren mittlerweile um Ihre Aufmerksamkeit. Die Frage ist nicht mehr „Soll ich KI nutzen?“, sondern „Welches Werkzeug passt zu meinem Zweck?”.[1]

Diese Vielfalt ist kein Zufall. Sie interagieren bereits erfolgreich mit KI – beim Online-Banking, bei der Reisebuchung, in Suchmaschinen. Große Sprachmodelle sind die nächste Stufe dieser Entwicklung: Systeme, die in natürlicher Sprache kommunizieren, komplexe Aufgaben verstehen und Sie bei Ihrer Arbeit unterstützen können. Die Herausforderung besteht darin, zwischen kommerziellen Plattformen, chinesischen Anbietern, europäischen Alternativen und offenen Modellen das Richtige für Ihre spezifischen Anforderungen zu wählen.

Der Markt hat sich 2025 grundlegend verschoben. Chinesische Modelle wie DeepSeek und Qwen verzeichneten erstmals mehr Downloads als US-amerikanische Konkurrenten. Gleichzeitig entstehen europäische Initiativen für digitale Souveränität, während die etablierten Anbieter ihre Funktionen kontinuierlich erweitern. Diese Übersicht strukturiert die Landschaft und hilft Ihnen, fundierte Entscheidungen zu treffen – nicht das „beste” Modell zählt, sondern das passende für Ihren Einsatzzweck.[2]

Was sind LLMs überhaupt – und was sind Plattformen?

Große Sprachmodelle (Large Language Models, LLMs) sind Computerprogramme, die durch Training mit Milliarden von Texten gelernt haben, menschliche Sprache zu verstehen und zu produzieren. Das Prinzip dahinter ist Mustererkennung: Das Modell analysiert, welche Wörter in welchen Kontexten typischerweise zusammen auftreten, und kann daraus neue Texte generieren, Fragen beantworten oder komplexe Aufgaben bearbeiten.[3]

Ein häufiges Missverständnis betrifft die Unterscheidung zwischen Modell und Plattform. Das Modell ist die eigentliche KI-Technologie – beispielsweise GPT-5.2 von OpenAI oder Claude Opus 4.6 von Anthropic. Die Plattform ist die Benutzeroberfläche, über die Sie mit dem Modell interagieren – etwa ChatGPT als Webseite oder App. Manche Plattformen bieten Zugang zu mehreren Modellen gleichzeitig, andere sind an ein spezifisches Modell gekoppelt.[3]

Der Begriff „Sprachmodell” ist mittlerweile eigentlich irreführend. Moderne LLMs können längst mehr als nur Text verarbeiten: Sie analysieren Bilder, generieren Code, verstehen Audio-Eingaben und kombinieren verschiedene Modalitäten. Die Technologie entwickelt sich von reinen Text-Systemen zu multimodalen Assistenten, die verschiedene Informationstypen integrieren. (→ Mehr dazu demnächst im Beitrag „Reasoning-Modelle verstehen”)[4]

Die vier Modell-Welten

Die aktuelle LLM-Landschaft lässt sich in vier große Kategorien einteilen, die jeweils unterschiedliche Stärken, Schwächen und Einsatzgebiete aufweisen.

Frontier-Modelle: Die Leistungsspitze aus den USA

Frontier-Modelle bezeichnen die leistungsstärksten kommerziellen Systeme, entwickelt von US-amerikanischen Unternehmen. Zu dieser Kategorie gehören GPT-5.2 von OpenAI, Claude Sonnet 4.6 und Opus 4.6 von Anthropic, Gemini 3 Pro von Google sowie Grok 4.1 von xAI. Diese Modelle dominieren den globalen Markt für KI-Chatbots. ChatGPT ist mit deutlichem Abstand Marktführer, gefolgt von Google Gemini und anderen Anbietern (Stand 17.Februar 2026).[5][6]

Diese Marktführerschaft bezieht sich auf Consumer-Plattformen mit Web-Interfaces. Im Open-Source-Segment zeigt sich ein anderes Bild: Hier dominieren chinesische Modelle wie Qwen und DeepSeek die Download-Statistiken bei Entwicklern.

Die Stärken dieser Systeme liegen in ihrer Leistungsfähigkeit bei komplexen Aufgaben. Claude Opus 4.6 überzeugt bei Coding-Aufgaben mit hoher Präzision und logischer Konsistenz. Gemini 3 Pro bietet ein Kontextfenster von über einer Million Token – das entspricht etwa 750.000 Wörtern, die das Modell gleichzeitig verarbeiten kann. Diese Modelle beherrschen Multimodalität nativ: Sie können Text, Bilder, Audio und teilweise Video in einem integrierten System verarbeiten.[7][6][4]

Besonders hervorzuheben ist der „Thinking”-Prozess bei modernen Modellen. Das System plant intern den Lösungsweg, bevor es die erste Antwort generiert – ein Ansatz, der die Qualität bei mathematischen, logischen und analytischen Aufgaben deutlich verbessert. Diese Reasoning-Fähigkeiten markieren einen Entwicklungssprung gegenüber früheren Generationen.[1]

Die Schwächen liegen primär in drei Bereichen. Erstens verursachen diese Modelle Kosten: Pro-Abonnements bewegen sich zwischen 20 und 60 Euro monatlich, Pay-per-Use-Modelle können bei intensiver Nutzung teurer werden. Zweitens stellt sich die Datenschutzfrage: Alle Daten werden auf US-amerikanischen Servern verarbeitet, was bei sensiblen Informationen problematisch sein kann. Drittens entsteht eine Abhängigkeit von kommerziellen Anbietern, die Preise, Funktionen und Verfügbarkeit jederzeit ändern können. (→ Mehr dazu demnächst im Beitrag „Plattformen und Modelle für den Alltag”)

Modelle aus China: Effizienz und Reasoning

Chinesische KI-Modelle haben 2025 einen bemerkenswerten Durchbruch im Open-Source-Segment erzielt. DeepSeek R1 und Qwen 2.5 Max von Alibaba dominieren die Download-Statistiken auf Hugging Face – der weltweit wichtigsten Plattform für offene KI-Modelle bei Entwicklern und technisch versierten Nutzern. Allein die Qwen-Modelle wurden 2025 über 750 Millionen Mal heruntergeladen und überholten damit Metas Llama-Familie mit 500 Millionen Downloads.[2].

Aktualisierung 11.4.2026

Aktuell zeichnet sich ein Strategiewechsel bezogen auf die QWEN-Modelle ab, die zunächst von Alibaba mit öffentlich zugänglichen Modellgewichten auf dem Markt waren. Die neueste Flaggschiff-Modelle von Alibaba sind als proprietäre, rein API-basierte Dienste ohne öffentliche Modellgewichte erschienen, mit der Folge, dass der API-Zugang zu den leistungsfähigsten Qwen-Modellen kostenpflichtig ist.[20]

Kleinere Modelle werden zunächst frei verfügbar bleiben. Das Muster erinnert an OpenAIs Entwicklung: Offenheit als Einstiegsstrategie, proprietäre Flaggschiffe als Monetarisierungsmodell.

Die Stärken dieser Modelle liegen in ihrer Effizienz und Spezialisierung. DeepSeek R1 hat sich bei Reasoning-Aufgaben – also logischem Schlussfolgern und mehrstufigen Problemlösungen – als besonders leistungsfähig erwiesen. Qwen2.5-Max zeigt in verschiedenen Benchmarks starke Leistungen. Die Modelle sind mehrsprachig ausgelegt und unterstützen multimodale Eingaben. Bemerkenswert ist das Preis-Leistungs-Verhältnis: Viele chinesische Modelle erzielen vergleichbare Ergebnisse wie westliche Konkurrenten bei deutlich geringeren Kosten.[8][4][3]

In der Europäischen Union sind diese Modelle mit begrenzter Präsenz verfügbar. DeepSeek R1 und Qwen2.5-Max sind technisch zugänglich – DeepSeek als Open-Source-Download, Qwen über Alibaba Clouds Frankfurter Infrastruktur. ERNIE 5.0 von Baidu startete Q1 2026 in globalem Beta-Zugang. GLM-4.5 (Zhipu) und Kimi K2.5 (Moonshot) sind als Open-Source verfügbar. Hinweis: Kimi 2.5 wurde für eine kurze Zeit im Perplexity-Portfolio mit Hosting in den USA angeboten (Stand 11.4.2026). Doubao (ByteDance) hat keine klare EU-Verfügbarkeit.

Wichtig: Der EU AI Act (seit August 2025) stellt strenge Anforderungen an Transparenz, Dokumentation und CE-Zertifizierung. Chinesische Modelle erfüllen diese Standards derzeit nicht und sind für High-Risk-Anwendungen (Finanzen, Gesundheit, Behörden) rechtlich problematisch. Bei Cloud-basierten chinesischen KI-Diensten besteht zudem das Risiko, dass Daten aufgrund chinesischer Gesetze (National Intelligence Law) an Behörden weitergegeben werden müssen. Für datenschutzkritische Anwendungen ist nur lokales Self-Hosting vertretbar.[1]

Die Schwächen betreffen primär rechtliche und qualitative Aspekte. DSGVO-Konformität ist nicht immer transparent dokumentiert, was bei der Verarbeitung personenbezogener Daten problematisch sein kann. Die Sprachqualität im Deutschen erreicht nicht durchgängig das Niveau der Frontier-Modelle, die auf umfangreichere deutschsprachige Trainingsdaten zurückgreifen können. Zudem besteht ein regulatorisches Risiko: Änderungen in der EU-China-Handelspolitik oder im AI Act können die Verfügbarkeit kurzfristig beeinflussen.

Souveräne DACH-Modelle: Datenschutz und Kontrolle

Die Diskussion um digitale Souveränität hat in der DACH-Region zur Entwicklung eigener Modelle geführt. Die bekanntesten Vertreter sind DeutschlandGPT, Teuken-7B aus dem OpenGPT-X-Projekt sowie spezialisierte Modelle wie BildungsLLM und Apertus.[9][10]

Teuken-7B ist das erste vollständig in Deutschland trainierte Sprachmodell, entwickelt auf Hochleistungsrechnern in Jülich und Dresden. Es unterstützt 24 europäische Sprachen und ist unter einer Open-Source-Lizenz auch für kommerzielle Zwecke nutzbar. Das Modell basiert auf 7 Milliarden Parametern – deutlich kleiner als Frontier-Modelle, aber für viele Anwendungsfälle ausreichend.[10][11]

DeutschlandGPT nimmt eine Sonderstellung ein. Die KI-Plattform wird vollständig in Deutschland entwickelt und betrieben – in Kooperation mit der Deutschen Telekom auf der Open Telekom Cloud. Das System ist TÜV-zertifiziert und auf höchste Datenschutz- und Sicherheitsstandards ausgelegt. Die DeutschlandGPT-Plattform ist seit 2025 verfügbar und richtet sich an Unternehmen und Bildungseinrichtungen. Das spezialisierte BildungsLLM (basierend auf Llama 3.3 70b) wurde im Mai 2025 angekündigt und ist seit Mitte 2025 über den Open Telekom Cloud Marketplace für öffentliche und private Bildungsträger zugänglich. Beide Angebote sind TÜV-zertifiziert, vollständig DSGVO-konform und werden ausschließlich in deutschen Rechenzentren betrieben.

Die Stärken liegen auf der Hand: DSGVO-konforme Datenverarbeitung auf europäischen Servern, reduzierte Abhängigkeit von außereuropäischen Anbietern, spezialisierte deutsche Sprachqualität bis hin zur Unterstützung von Dialekten. Für Hochschulen, Behörden und Unternehmen mit strengen Datenschutzanforderungen sind diese Modelle oft die einzige realistische Option.[11][10]

Die Schwächen betreffen Leistung und Verfügbarkeit. Kleinere Modelle wie Teuken-7B erreichen bei komplexen Reasoning-Aufgaben nicht die Performance der Frontier-Modelle. Die Entwickler-Community ist kleiner, was langsamere Updates und weniger Drittanbieter-Tools bedeutet. Zudem fehlen bei den meisten DACH-Modellen benutzerfreundliche Chat-Interfaces – eine Ausnahme bildet DeutschlandGPT. Die technische Hürde für den Einstieg ist dadurch höher. (→ Mehr dazu demnächst im Cluster „Datensouveränität, Bias und Urheberrechte”)[11][9]

Offene Modelle: Kontrolle und Anpassbarkeit

Offene Modelle (Open Source) werden unter Lizenzen veröffentlicht, die freie Nutzung, Modifikation und Weiterverbreitung erlauben. Führende Vertreter sind Llama 4 von Meta (Scout, Maverick, Behemoth), Mistral Large von Mistral AI sowie die offenen Varianten von Qwen, DeepSeek und GLM.[12][13]

Metas Llama 4-Familie setzt neue Maßstäbe im Open-Source-Bereich. Llama 4 Scout nutzt eine Mixture-of-Experts-Architektur mit 17 Milliarden aktiven Parametern (von 109 Milliarden gesamt) und unterstützt theoretisch ein revolutionäres 10-Millionen-Token-Kontextfenster – das größte in der Open-Source-Welt. In der Praxis limitieren Cloud-Anbieter das Context Window auf 131.000 bis 192.000 Token, da die vollständige Nutzung enorme Hardware-Ressourcen erfordert und bei Auslastung über 90% die Performance deutlich sinkt.

Llama 4 Maverick verfügt über 400 Milliarden Gesamtparameter (17 Milliarden aktiv durch Mixture-of-Experts mit 128 Experten) und ein Kontextfenster von 512.000 bis 1 Million Token – abhängig von der Implementierung. Meta positioniert Maverick als konkurrenzfähig zu proprietären Modellen bei Coding und Reasoning, mit deutlich niedrigeren Betriebskosten durch Einsatz auf einer einzelnen H100-GPU.

Das angekündigte Flaggschiff Llama 4 Behemoth mit 288 Milliarden aktiven Parametern (von fast 2 Billionen gesamt) und nativ multimodalen Fähigkeiten ist Stand Februar 2026 nicht öffentlich verfügbar. Meta verschob die ursprünglich für April 2025 geplante Veröffentlichung mehrfach aufgrund interner Bedenken zur Performance. Das Modell dient derzeit als “Teacher Model” zur Verbesserung der verfügbaren Llama 4-Varianten.[13]

Die Stärken offener Modelle liegen in Kontrolle und Flexibilität. Sie können lokal auf eigener Hardware betrieben werden – ohne Datenübertragung an externe Server. Es gibt keine Vendor-Lock-ins: Sie sind nicht an einen kommerziellen Anbieter gebunden und können das Modell beliebig anpassen. Die Transparenz ist höher: Bei Open-Source-Modellen können Sie die Architektur und Trainingsdaten einsehen, soweit dokumentiert. Für spezialisierte Anwendungen lassen sich die Modelle mit eigenen Daten nachtrainieren (Fine-Tuning).

Die Schwächen betreffen technischen Aufwand und Ressourcen. Der Betrieb großer Modelle erfordert leistungsfähige Hardware – Llama 4 Maverick benötigt beispielsweise spezialisierte GPUs mit ausreichend Speicher. Für nicht-technische Nutzende ist die Einrichtung komplex: Installation, Konfiguration und Wartung setzen IT-Kenntnisse voraus. Zudem gibt es rechtliche Einschränkungen: Metas Llama 4-Modelle unterliegen in der EU Nutzungsbeschränkungen, die kommerzielle Anwendungen einschränken können. (→ Mehr dazu demnächst im Cluster „Offene Modelle – Installation und Nutzung”)[13]

Aktuell relevante Plattformen und Browser-Lösungen

Neben den Modellen selbst bestimmen die Plattformen, wie Sie im Alltag mit KI interagieren. Die Landschaft teilt sich in drei Kategorien.

Dedizierte KI-Plattformen

ChatGPT von OpenAI bleibt mit deutlichem Abstand die meistgenutzte Plattform, gefolgt von Google Gemini und Perplexity. Die Plattform bietet Zugang zu GPT-5.2 und weiteren OpenAI-Modellen, sowohl in einer kostenlosen Basisversion als auch in Pro-Abonnements ab 20 Euro monatlich. Claude von Anthropic konzentriert sich auf seine eigene Modellfamilie (Sonnet 4.5, Opus 4.6) und positioniert sich als Alternative mit Fokus auf technische Genauigkeit und längere Kontexte. Gemini von Google integriert die Gemini-Modelle mit direktem Zugang zu Google-Diensten und Suchfunktionen.[6][14][7]

Perplexity nimmt eine Sonderstellung ein: Die Plattform kombiniert verschiedene Modelle (GPT, Claude, Gemini) mit Echtzeit-Websuche und Quellenangaben. Das macht sie besonders stark für Recherche-Aufgaben, bei denen aktuelle Informationen und Faktenchecks wichtig sind. Google Cloud Vertex AI richtet sich primär an Unternehmen und Entwickler, ermöglicht aber Zugang zu mehreren Modellen über eine einheitliche Schnittstelle.[14][15]

Browser-integrierte Lösungen

Eine neue Kategorie sind KI-Browser und KI-Integrationen in etablierte Browser, die generative Modelle direkt in die Browser-Oberfläche einbinden. Dabei gibt es zwei Ansätze: Eigenständige AI-Browser (wie ChatGPT Atlas) und AI-Integrationen in bestehende Browser (wie Gemini in Chrome oder Copilot in Edge).

Google Chrome mit Gemini-Integration bietet seit September 2025 einen AI-Assistenten direkt im Browser. Anders als Atlas ist Gemini keine eigenständige Browser-Lösung, sondern eine Integration in Chrome: Eine Side Panel-Leiste ermöglicht Zugriff auf Gemini, während ein AI Mode in der Adressleiste natürlichsprachliche Queries verarbeitet. Das Update vom 28. Januar 2026 brachte Gemini 3 und die Preview-Funktion Auto Browse, die automatisierte Multi-Step-Tasks wie Reisebuchungen oder Einkäufe ausführen kann. Die Stärke liegt in der tiefen Integration mit Google-Diensten: Gemini kann Gmail, Calendar, YouTube, Maps und Google Shopping verknüpfen und komplexe Cross-App-Workflows durchführen. Die Funktionen sind für alle Chrome-Nutzer kostenlos verfügbar.

OpenAI startete am 21. Oktober 2025 ChatGPT Atlas für macOS, mit geplanter Expansion auf Windows, iOS und Android. Die Besonderheit: Eine „Ask ChatGPT”-Seitenleiste bleibt beim Browsen geöffnet und kann Webseiten analysieren, ohne dass Sie Inhalte kopieren müssen.[14]

Microsoft reagierte zwei Tage später mit dem Copilot Mode in Edge. Das System kann mit Ihrer Erlaubnis offene Tabs sehen, Informationen zusammenfassen und vergleichen sowie Aktionen ausführen – etwa Formulare ausfüllen oder Hotelbuchungen vornehmen. Die Funktionen werden kontinuierlich erweitert; geplant ist der Zugriff auf Browserverlauf und Anmeldedaten für automatisierte Aufgaben.[16][17]

Perplexity veröffentlichte im Juli 2025 den Comet-Browser (zunächst für Perplexity-Max-Abonnenten) und machte ihn im Oktober 2025 kostenlos für alle verfügbar. Die Desktop-Version (Windows, macOS) wurde im November 2025 um eine Android-App ergänzt; eine iOS-Version ist angekündigt.[14]

Hochschulplattformen

Die Academic Cloud, betrieben von der GWDG, bietet niedersächsischen und weiteren deutschen Hochschulangehörigen kostenlosen Zugang zu KI-Modellen. Der Service Chat AI umfasst kommerzielle Modelle (GPT-3.5, GPT-4) und intern gehostete Open-Source-Alternativen (Llama 3, Mixtral, Qwen, Intel Neural Chat). Die Plattform garantiert DSGVO-Konformität: Chat-Verläufe werden nicht gespeichert, Daten nicht für Training verwendet, und die Infrastruktur läuft in akademischen Rechenzentren nach deutschen Datenschutzrichtlinien. Der Zugang erfolgt über reguläre Hochschul-Login-Daten ohne separate Registrierung. Neben Chat AI stehen Image AI und Voice AI für Bild- und Audio-Verarbeitung zur Verfügung.

Für Studierende und Hochschulangehörige sind spezialisierte Campus-Plattformen relevant. HAWKI ist eine Open-Source-Plattform, die deutschen Hochschulen datenschutzkonformen Zugang zu generativen KI-Modellen ermöglicht. Hochschulangehörige melden sich mit ihrer Hochschulkennung an und können dann verschiedene KI-Funktionen nutzen, inklusive KI-unterstützter Gruppenchats für gemeinsame Diskussionen.[18]

HAWKI2, die nächste Entwicklungsstufe, entwickelt sich von einer reinen Schnittstelle zu einem eigenständigen KI-Ökosystem. Hochschulen können eigene Daten vektorisieren, damit die KI hochschulinternes Wissen nutzt und darauf verweist. Das Ziel ist digitale Souveränität und reduzierte Abhängigkeit von kommerziellen Anbietern. Academic Cloud und ähnliche Initiativen verfolgen vergleichbare Ansätze an verschiedenen Hochschulverbünden.[19]

Die Stärken dieser Hochschulplattformen liegen in DSGVO-Konformität, oft kostenlosem Zugang für Studierende und Integration in bestehende Campus-Systeme. Die Schwächen betreffen begrenzte Modellauswahl und teilweise eingeschränkte Funktionalität im Vergleich zu kommerziellen Plattformen. (→ Mehr dazu demnächst)

Entscheidungskriterien: Was ist für Sie wichtig?

Die Wahl des passenden Modells hängt von sieben zentralen Kriterien ab. Diese Tabelle strukturiert die Unterschiede zwischen den vier Modell-Welten:

| Kriterium | Frontier-Modelle | China-Modelle | DACH-Modelle | Offene Modelle |

| Leistung bei komplexen Aufgaben | Sehr hoch [7]; Coding und Reasoning exzellent | Hoch [3]; speziell Reasoning stark | Mittel [11]; für Standardaufgaben ausreichend | Hoch bis sehr hoch [13]; Llama 4 Maverick vergleichbar mit proprietären Modellen |

| Leistung bei speziellen Aufgaben | Multimodal [4]; Text, Bild, Audio, Video integriert | Sehr gut [8]; Effizienz, mehrsprachig | Exzellent [10]; deutsche Sprache/Dialekte | Anpassbar durch Fine-Tuning für Spezialfälle |

| Datenschutz/Souveränität | Schwach; US-Server, Cloud Processing Act-Risiken | Schwach; DSGVO-Status unklar, regulatorisches Risiko | Sehr stark [9]; DSGVO-konform, deutsche Server, Audits | Sehr stark; lokaler Betrieb möglich, keine Datenübertragung |

| Ethik/Urheberrecht | Intransparent; Trainingsdaten oft nicht offengelegt | Intransparent; Quellen nicht dokumentiert | Transparenter [11]; OpenGPT-X dokumentiert Daten | Transparent; Open-Source-Lizenz, anpassbare Policies |

| Kosten | Mittel bis hoch; 0–60 €/Monat oder Pay-per-Use | Niedrig bis mittel; oft günstiger als US-Konkurrenz | Variabel; Campus oft kostenlos | Einmalig Hardware; danach nur Betriebskosten (Strom) |

| Zugänglichkeit | Sehr einfach; Webinterface, Apps, keine Setup | Einfach; über Plattformen, teils begrenzt in EU | Mittel; oft kein Chat-Interface [9], technische Hürden | Schwierig [13]; IT-Kenntnisse, GPU-Hardware erforderlich |

| Sprachqualität Deutsch | Sehr gut; umfangreiches Training deutschsprachiger Daten | Gut bis mittel; mehrsprachig, aber nicht Deutsch-optimiert | Exzellent [10]; Teuken-7B 24 EU-Sprachen, Dialekte | Sehr gut; Llama 4 mehrsprachig trainiert |

Diese Matrix bietet keine Wertung „besser oder schlechter”, sondern verdeutlicht: Jede Modell-Welt hat spezifische Stärken. Frontier-Modelle glänzen bei komplexen Aufgaben, wenn Kosten und Datenschutz zweitrangig sind. China-Modelle bieten Preis-Leistungs-Vorteile bei Reasoning-Tasks. DACH-Modelle sind die Wahl für sensible Daten und regulierte Bereiche. Offene Modelle ermöglichen maximale Kontrolle für technisch Versierte.

Ihre Entscheidung sollte nicht abstrakt, sondern anwendungsbezogen erfolgen. Was möchten Sie konkret tun? Die folgenden fünf Einsatzfelder strukturieren typische Szenarien.

Fünf Einsatzfelder: Was wollen Sie tun?

Studium: Fachtexte verstehen und Vorlesungen nacharbeiten

Sie bearbeiten wissenschaftliche Papers, arbeiten Vorlesungsnotizen nach oder strukturieren Seminararbeiten. Hier sind lange Kontexte wichtig: Das Modell muss komplette Artikel oder Kapitellängen verarbeiten können. Gemini 3 Pro bietet ein sehr großes Kontextfenster und eignet sich für umfangreiche Research-Dokumente. Claude Sonnet 4.5/Opus 4.6 überzeugt bei der Analyse spezifischer Dokumente mit Fokus auf technische Genauigkeit.[7][6]

Für Hochschulangehörige mit Campus-Zugang ist HAWKI eine kostengünstige, datenschutzkonforme Alternative. Die Plattform ermöglicht Gruppenchats mit KI-Unterstützung – ideal für kollaborative Lernprozesse. Der Nachteil: Die Modellauswahl ist begrenzt im Vergleich zu kommerziellen Anbietern.[18]

Recherche: Papers finden und Quellen prüfen

Bei Literaturrecherche und Quellenvalidierung ist Echtzeit-Webzugang entscheidend. Perplexity dominiert diesen Bereich: Die Plattform kombiniert verschiedene Modelle mit Live-Suche und liefert Quellenangaben zu jeder Aussage. Das macht Faktenchecks transparent und reduziert Halluzinationen – falsche, aber plausibel klingende Informationen.[15][14]

ChatGPT mit Web-Browsing bietet ähnliche Funktionen, ist aber stärker auf Konversation als auf Recherche-Workflows optimiert. Gemini profitiert von der Google-Integration und kann auf aktuelle Suchergebnisse zugreifen. Wichtig: Bei allen Modellen sollten Sie Quellenangaben manuell gegenchecken – KI ist ein Recherchetool, kein Ersatz für kritisches Denken.[6]

Alltag: Behördenbriefe und Verträge verstehen

Komplexe Verwaltungsschreiben, Versicherungsverträge oder juristische Dokumente enthalten oft sensible personenbezogene Daten. Hier ist Datenschutz prioritär. Laden Sie solche Dokumente niemals in kommerzielle Cloud-Dienste hoch, ohne die Datenschutzrichtlinien zu prüfen.

Für DSGVO-kritische Anwendungen sind DACH-Modelle oder lokal betriebene offene Modelle die einzigen verantwortbaren Optionen. DeutschlandGPT bietet Unternehmen und Bildungseinrichtungen eine auditierbare Lösung. Technisch versierte Privatpersonen können Llama 4 Scout lokal installieren – das kleinere Modell ist für Dokumentenanalyse ausreichend und benötigt moderate Hardware-Ressourcen.[9][13]

Alternativ: Anonymisieren Sie Dokumente vor dem Upload (Namen, Adressen, Kontonummern entfernen), dann können auch kommerzielle Dienste genutzt werden. Das funktioniert bei standardisierten Verträgen, nicht aber bei individuellen Fallschilderungen.

Brainstorming: Projektideen und Perspektiven entwickeln

Für kreatives Denken, Ideengenerierung und Perspektivwechsel sind konversationsstarke Modelle optimal. ChatGPT (GPT-5.2) gilt als Referenz für natürliche, flüssige Dialoge. Die Stärke liegt in der Fähigkeit, verschiedene Ansätze zu explorieren und auf Nachfragen flexibel zu reagieren.[7]

Claude überzeugt bei technisch-analytischem Brainstorming und bietet detaillierte Begründungen. Gemini punktet durch Integration verschiedener Modalitäten – Sie können Bilder, Texte und Ideen kombinieren. Bei Brainstorming-Anwendungen sind Datenschutzbedenken meist geringer, da keine personenbezogenen Daten verarbeitet werden. Trotzdem gilt: Geschäftsgeheimnisse und vertrauliche Projektdetails gehören nicht in kommerzielle Plattformen. (→ Mehr dazu demnächst im Cluster „Use Cases für LLMs im Alltag”)[7]

Kreativ: Songtexte, Blog-Beiträge, Storytelling

Kreative Textproduktion – ob Gedichte, Geschichten oder Social-Media-Beiträge – funktioniert mit allen Frontier-Modellen gut. GPT-5.2 liefert flüssige, stilistisch angepasste Texte und kann verschiedene Genres imitieren. Claude fokussiert auf technische Präzision und eignet sich für sachliche Texte mit hohen Qualitätsansprüchen.[7]

Wichtig: Bei kreativer Arbeit ist der Schutz Ihres eigenen geistigen Eigentums relevant. Texte, die Sie in kommerzielle Plattformen eingeben, werden möglicherweise für Training oder Analyse genutzt – Details variieren je nach Anbieter und Tarif. Für sensible kreative Projekte (Buchmanuskripte, Patentanmeldungen) sollten Sie entweder lokale Modelle nutzen oder nur mit fragmentierten, nicht-identifizierbaren Textpassagen arbeiten. Die urheberrechtliche Situation bei KI-generierten Inhalten bleibt eine Grauzone – aktuelle Rechtsprechung entwickelt sich noch. (→ Mehr dazu demnächst im Cluster „Datensouveränität, Bias und Urheberrechte”)

Ihr Entscheidungsbaum: In sechs Fragen zum passenden Modell

Die folgende Schritt-für-Schritt-Logik hilft bei der Auswahl. Beantworten Sie die Fragen nacheinander:

1. Arbeiten Sie mit sensiblen personenbezogenen Daten? – Ja (Gesundheitsdaten, Finanzen, juristische Dokumente): → DACH-Modelle (DeutschlandGPT, HAWKI) oder lokale offene Modelle (Llama 4 Scout) – Nein: → Weiter zu Frage 2

2. Brauchen Sie höchste Leistung bei komplexen Aufgaben? – Ja (Advanced Coding, mehrstufiges Reasoning, multimodale Integration): → Frontier-Modelle (Claude Opus 4.6 für Coding, Gemini 3 Pro für lange Kontexte)[6][7] – Nein: → Weiter zu Frage 3

3. Wie wichtig sind Ihnen Datenschutz, Bias-Vermeidung und Transparenz bei Urheberrecht? – Sehr wichtig (digitale Souveränität prioritär): → DACH-Modelle oder offene Modelle mit lokaler Installation – Wichtig, aber nicht entscheidend: → Weiter zu Frage 4

4. Haben Sie viele verschiedene Aufgaben oder arbeiten Sie in einem speziellen Bereich? – Vielfältig (Alltags-Mix aus Recherche, Schreiben, Analyse): → Allrounder wie ChatGPT oder Perplexity für Recherche-Fokus[15][6] – Spezialisiert (z. B. nur wissenschaftliche Recherche, nur Programmierung): → Spezialisierte Modelle (Claude für Code, Gemini für Research)[6][7]

5. Haben Sie Campus-Zugang zu einer Hochschule? – Ja: → HAWKI oder Academic Cloud prüfen – oft kostenlos und DSGVO-konform[18] – Nein: → Weiter zu Frage 6

6. Sind Sie technisch versiert und haben Zugang zu leistungsfähiger Hardware? – Ja (IT-Kenntnisse, GPU verfügbar): → Offene Modelle erwägen (Llama 4 Maverick für maximale Kontrolle)[13] – Nein: → Kommerzielle Plattformen mit Webinterface (ChatGPT, Claude, Gemini, Perplexity)

Bonus-Frage: Was ist Ihr Budget? – 0 Euro: Free-Versionen (Perplexity Basis, ChatGPT Free, Gemini) oder Campus-Plattformen[14][18] – Bis 20 Euro/Monat: Pro-Abos (ChatGPT Plus, Claude Pro, Perplexity Pro)[14] – Flexibel: Pay-per-Use bei intensiver Nutzung oder Einmalinvestition in Hardware für lokale Modelle

Das bedeutet für Sie: Praktische Handlungsempfehlungen

Die beste Strategie ist experimentelles Lernen. Starten Sie mit kostenlosen oder Campus-Versionen, um verschiedene Ansätze zu testen. Perplexity Free eignet sich für erste Recherche-Erfahrungen mit Quellenangaben. ChatGPT Free bietet Zugang zur Konversations-KI ohne finanzielle Verpflichtung. Falls Sie Hochschulzugang haben, nutzen Sie HAWKI für datenschutzkonforme Tests.[18][14]

Testen Sie zwei bis drei Plattformen für Ihre häufigsten Aufgaben. Formulieren Sie dieselbe Anfrage in verschiedenen Systemen und vergleichen Sie Qualität, Geschwindigkeit und Nutzererfahrung. Dokumentieren Sie: Welches Modell liefert bei Ihrer spezifischen Aufgabe die besten Ergebnisse? Diese empirische Evaluation ist wertvoller als abstrakte Benchmarks.

Entwickeln Sie eine Aufgaben-Modell-Zuordnung. Nutzen Sie nicht ein System für alles, sondern wählen Sie das passende Werkzeug pro Kontext: Perplexity für Recherche, Claude für Programmierung, DACH-Modelle für sensible Daten. Diese Strategie maximiert Qualität und minimiert Risiken.[15][9][7]

Bleiben Sie kritisch bei der Quellenvalidierung. Kein Modell ist fehlerfrei – Halluzinationen kommen vor, selbst bei Frontier-Systemen. Prüfen Sie Fakten, Zitate und Quellenangaben manuell nach, besonders bei wissenschaftlichen oder juristischen Anwendungen. KI ist ein Recherche-Assistent, kein Ersatz für Ihr Urteilsvermögen. (→ Mehr dazu demnächst im Tutorial „Perplexity Pro einrichten”)[7]

Grenzen und offene Fragen: Was Sie wissen sollten

Die LLM-Landschaft ist hochdynamisch. Neue Modelle erscheinen monatlich, Preise ändern sich, Funktionen werden hinzugefügt oder entfernt. Diese Übersicht bildet den Stand Februar 2026 ab – in sechs Monaten kann die Situation bereits deutlich anders aussehen. Planen Sie mit dieser Unsicherheit: Vermeiden Sie langfristige Festlegungen auf einzelne Plattformen, wenn möglich.

Benchmarks sind mit Vorsicht zu interpretieren. Hersteller veröffentlichen Tests, die ihre eigenen Modelle bevorzugt darstellen. Unabhängige Benchmarks wie das HELM-Projekt von Stanford oder Hugging Face Leaderboards bieten objektivere Vergleiche, bewerten aber oft spezifische Aufgaben, die für Ihren Anwendungsfall irrelevant sein können. Ein Modell, das bei mathematischen Aufgaben führt, kann bei kreativer Textproduktion mittelmäßig sein. (→ Mehr dazu demnächst im Cluster „Benchmarks verstehen”)[1]

Die rechtliche Situation bleibt eine Grauzone. Urheberrecht bei KI-generierten Inhalten ist international uneinheitlich geregelt. In Deutschland gilt aktuell: KI-Output ist nicht automatisch urheberrechtlich geschützt, wenn keine menschliche Schöpfungshöhe vorliegt. Die Nutzung urheberrechtlich geschützten Materials im Training von Modellen wird gerichtlich noch geklärt. Handeln Sie vorsichtig bei kommerzieller Nutzung KI-generierter Inhalte – die Rechtslage entwickelt sich.

Dieser Beitrag wird quartalsweise aktualisiert, um mit der Marktentwicklung Schritt zu halten. Die nächste Überarbeitung ist für Mai 2026 geplant. Feedback zu veralteten Informationen oder fehlenden Modellen ist willkommen – die LLM-Landschaft kann niemand vollständig überblicken, aber gemeinsam können wir sie besser kartografieren.

Benchmarks: Wo finde ich objektive Vergleiche?

Für evidenzbasierte Entscheidungen sind unabhängige Benchmark-Quellen hilfreich. Das Hugging Face Open LLM Leaderboard bewertet offene Modelle nach standardisierten Tests und wird kontinuierlich aktualisiert. Die Plattform dokumentiert Download-Zahlen, was Popularität und Community-Akzeptanz zeigt – 2025 dominierten chinesische Modelle mit über 44 Prozent der Downloads.[2]

Das HELM-Projekt (Holistic Evaluation of Language Models) der Stanford University testet Modelle über multiple Dimensionen: Genauigkeit, Robustheit, Fairness, Effizienz. HELM vermeidet Single-Metric-Rankings und zeigt Stärken-Schwächen-Profile. Die Herstellerwebsites (OpenAI, Anthropic, Google, Alibaba, Meta) veröffentlichen eigene Benchmarks – diese sind mit Skepsis zu lesen, da sie Eigeninteressen dienen.

Eigene Tests sind am aussagekräftigsten für Ihren Kontext. Formulieren Sie repräsentative Aufgaben aus Ihrem Alltag und testen Sie verschiedene Modelle systematisch. Dokumentieren Sie Qualität, Geschwindigkeit und Kosten. Dieser Aufwand lohnt sich bei regelmäßiger Nutzung: Sie finden das System, das für Sie – nicht abstrakt – am besten funktioniert. (→ Mehr dazu demnächst im Cluster „Benchmarks verstehen und interpretieren”)

Quellenverzeichnis

- All-AI.de: Die besten Sprachmodelle im Juni 2026 (LLM) – https://www.all-ai.de/tools/ki-top-tools100/sprachmodelle-llm-uebersicht

- The Decoder: Halb-offene KI-Modelle aus China verdrängen die US-Konkurrenz – https://the-decoder.de/halb-offene-ki-modelle-aus-china-verdraengen-die-us-konkurrenz/

- Botpress: The 10 Best Large Language Models (LLMs) in 2026 – https://botpress.com/de/blog/best-large-language-models

- Moin AI: Die größten Sprachmodelle (LLMs) – https://www.moin.ai/chatbot-lexikon/grosse-sprachmodelle-llms

- Unite.AI: Die 5 besten Large Language Models (LLMs) im Februar 2026 – https://www.unite.ai/de/best-large-language-models-llms/

- Findskill.ai: ChatGPT vs Claude vs Gemini: Der ehrliche Vergleich 2026 – https://findskill.ai/de/blog/chatgpt-vs-claude-vs-gemini-der-ehrliche-vergleich-2026/

- Kanerika: ChatGPT vs Gemini vs Claude: Which AI Model Wins in 2026? – https://kanerika.com/blogs/chatgpt-vs-gemini-vs-claude/

- WirtschaftsWoche: China: Ist die Alibaba-KI besser als DeepSeek? – https://www.wiwo.de/unternehmen/it/ki-modelle-aus-china-ist-die-alibaba-ki-besser-als-deepseek/30191692.html

- SAP News: OpenAI und SAP: Eine bahnbrechende Partnerschaft – https://news.sap.com/germany/2025/09/sap-und-openai-starten-partnerschaft-fuer-sovereign-openai-in-deutschland/

- Unidigital.news: Teuken-7B: Erstes Sprachmodell der deutschen Initiative OpenGPT-X – https://www.unidigital.news/teuken-7b-erstes-sprachmodell-der-deutschen-initiative-opengpt-x-ab-sofort-open-source-fuer-kommerzielle-zwecke-verwendbar/

- PC Masters: OpenGPT-X Teuken-7B: Europas Open-Source-KI-Sprachmodell – https://www.pcmasters.de/news/133713881-opengpt-x-teuken-7b-europas-open-source-ki-sprachmodell-antwort-auf-gpt-3-mit-24-sprachen-unterstuetzung.html

- Xpert.Digital: Meta veröffentlicht neue KI-Modellreihe Llama 4 – https://xpert.digital/meta-llama-4/

- Evoya.ai: Meta Llama 4: Neue offene KI-Modelle – https://evoya.ai/blog/meta-llama-4-neue-offene-ki-modelle-mit-bis-zu-10-mio-token-kontextfenster/

- Kanerika: Perplexity vs ChatGPT: Which Tool Fits Your Needs in 2026 – https://kanerika.com/blogs/perplexity-vs-chatgpt/

- Nexos.ai: Perplexity vs ChatGPT comparison in 2026 – https://nexos.ai/blog/perplexity-vs-chatgpt/

- TechCrunch: Microsoft launches a nearly identical AI browser – https://techcrunch.com/2025/10/23/two-days-after-openais-atlas-microsoft-launches-a-nearly-identical-ai-browser/

- Microsoft: Introducing Copilot Mode in Edge – https://blogs.windows.com/msedgedev/2025/07/28/introducing-copilot-mode-in-edge-a-new-way-to-browse-the-web/

- HAWK: HAWKI – Interface zu generativen KI-Modellen – https://www.hawk.de/de/forschung/transfer-und-kooperationen/hawki

- Hochschulforum Digitalisierung: HAWKI2 – eigenständiges KI-Ökosystem – https://hochschulforumdigitalisierung.de/eigenstaendiges-ki-oekosystem-fuer-hochschulen/

- Alibaba stellt das dritte Closed-Source-KI-Modell mit Fokus auf Profit vor – Bloomberg