und schon wieder ein neues LLM u.a. in Perplexity Pro verfügbar

NVIDIA hat Mitte März ein bemerkenswertes Modell veröffentlicht – und wer Perplexity Pro nutzt, findet es dort sofort einsatzbereit: Nemotron 3 Super arbeitet schnell, verarbeitet sehr lange Texte in einem Durchgang und legt seine Architektur als Open-Weight-Modell offen. Was das konkret bedeutet, wo das Modell an Grenzen stößt und für welche Aufgaben es sich lohnt…

Transparenz

Text und Bild(er) mit KI-Unterstützung erarbeitet.

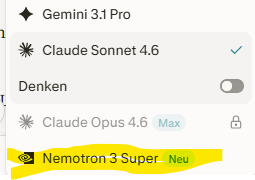

NVIDIA hat am 11. März 2026 das LargeLanguageModell Nemotron 3 Super veröffentlicht.Seit dem 15. März ist es u.a. direkt in Perplexity Pro verfügbar. Wer Perplexity Pro nutzt, findet Nemotron 3 Super dort als neue Auswahloption neben GPT-5.4, Claude Sonnet 4.6 und Gemini 3 Pro (Stand 26.3.2026).

Was steckt dahinter?

Nemotron 3 Super ist ein sogenanntes Open-Weight-Modell: Die Modellgewichte sind öffentlich zugänglich, können geprüft und für eigene Zwecke eingesetzt werden. Das unterscheidet es grundlegend von proprietären Modellen wie GPT-5.4, deren innere Architektur verschlossen bleibt. Technisch arbeitet das Modell wie ein Team von Spezialisten – je nach Aufgabe werden unterschiedliche „Expertenschaltkreise” aktiviert, während der Rest inaktiv bleibt.

- Das macht es effizient, ohne an Qualität einzubüßen.

Eine zweite Besonderheit: Nemotron kombiniert zwei Architekturfamilien, die bislang selten gemeinsam auftraten – klassische Transformer-Schichten für präzises Schlussfolgern und sogenannte Mamba-Schichten für die effiziente Verarbeitung sehr langer Texte.

- Das Ergebnis: Das Modell vergisst bei umfangreichen Eingaben nicht, was am Anfang stand – ein strukturelles Problem vieler früherer Modellversionen.

Datenschutz, Urheberrecht und BIAS– was NVIDIA dokumentiert

NVIDIA setzt automatisierte Filter-Tools ein, darunter Microsoft Presidio, die personenbezogene Daten wie E-Mail-Adressen, Telefonnummern und Kreditkartendaten bereits aus den Trainingsdaten entfernen. Synthetische Trainingsdaten wurden grundsätzlich ohne jegliche personenbezogenen Daten erstellt. Beim Urheberrecht dokumentiert NVIDIA einen aktiven Review-Prozess: Urheberrechtlich geschützte Inhalte werden nach der Datenerhebung identifiziert und entfernt; Rechteinhaber können aktiv widersprechen. Wie alle großen Sprachmodelle kann auch Nemotron 3 Super Verzerrungen (BIAS) aus den Trainingsdaten aufweisen – NVIDIA benennt das selbst und empfiehlt für kritische Einsatzbereiche gezielte Überprüfungen.

Stärken, Grenzen – eine erste Einordnung

Nemotron 3 Super fällt im direkten Vergleich zu einigen anderen LLM vor allem durch Geschwindigkeit auf: Lange Dokumente, ausgedehnte Gesprächsverläufe oder umfangreiche Texte werden spürbar schneller beantwortet als bei den Vergleichsmodellen. Hinzu kommt ein ungewöhnlich großes Kontextfenster – sehr lange Texte lassen sich in einem Durchgang verarbeiten, was bei wissenschaftlichen Lektüren, Behördentexten oder längeren Recherchen einen praktischen Unterschied macht. (Grundlage: Artificial Analysis, ein unabhängiges Benchmark-Portal mit laufend aktualisierten Modellvergleichen – methodisch transparent, aber keine Peer-Review-Publikation.) und eigene Wahrnehmung.

Bei Aufgaben, die tiefes mehrstufiges Schlussfolgern erfordern, liegen Claude Sonnet 4.6 im Thinking-Modus und GPT-5.4 nach aktuellem Stand vorn. Gemini 3 Pro hebt sich durch multimodale Breite ab – Text, Bild, Sprache und Video in einem Modell, was Nemotron 3 Super nicht leistet. Für deutschsprachige Aufgaben lohnt ein kritischer Blick: Das Training ist stark Englisch-dominiert, was bei anspruchsvollen deutschen Texten gelegentlich spürbar werden kann. Benchmark-Zahlen bilden stets eine Momentaufnahme – die Abstände zwischen Modellen verschieben sich mit jedem Update.

Was bringt es konkret?

Nemotron 3 Super eignet sich besonders für Aufgaben, bei denen Umfang und Geschwindigkeit zählen: lange wissenschaftliche Texte zusammenfassen, umfangreiche Dokumente strukturieren, Recherchen über mehrere Quellen hinweg bündeln oder Argumentationslinien in langen Texten nachverfolgen. Wer im Seniorenstudium Vorlesungsmitschriften aufbereitet, Fachliteratur erschließt oder Texte für Citizen-Science-Projekte auswertet, findet hier ein leistungsfähiges Werkzeug – vorausgesetzt, die Ergebnisse werden, wie bei jedem KI-Modell, kritisch geprüft.